Jahrelang galt eine einfache Regel: Wer bei Google gefunden wird, existiert. Diese Regel gilt immer noch – aber sie ist nicht mehr die ganze Wahrheit. ChatGPT, Claude, Perplexity und Gemini lesen heute selbst Websites, fassen Inhalte zusammen und liefern Antworten direkt an den Nutzer. Ohne Klick. Ohne Besuch. Ohne dass du es merkst.

Die Frage ist nicht mehr nur: Rankt deine Website bei Google? Sondern auch: Versteht dich ein KI-Agent, wenn er vorbeikommt? Cloudflare hat dafür kürzlich einen Begriff etabliert und ein kostenloses Tool veröffentlicht – Agent Readiness. Wir haben es selbst ausprobiert und dabei einiges gelernt.

Was ist Agent Readiness?

Agent Readiness beschreibt, wie gut eine Website auf den Besuch von KI-Agenten vorbereitet ist. Also nicht mehr nur auf Menschen und Suchmaschinen-Crawler, sondern auf autonome Systeme, die Inhalte lesen, verstehen und weiterverarbeiten.

Die Analogie ist einfach: Vor 20 Jahren musstest du deine Seite für Suchmaschinen optimieren – das nannten wir SEO. Heute kommen KI-Agenten dazu, und dafür braucht es AEO: Answer Engine Optimization. Die Prinzipien sind verwandt, aber die Anforderungen sind neu. Ein Agent will nicht deine hübschen Bilder oder aufwendigen Animationen – er will strukturierte, maschinenlesbare Informationen, die sich schnell und klar extrahieren lassen.

Wer das ignoriert, riskiert genau das, was früher schlechte SEO bedeutete: unsichtbar zu sein. Nur dass der Suchende diesmal nicht mehr Google heißt, sondern ChatGPT oder Claude.

Das Cloudflare-Tool: isitagentready.com

Cloudflare hat mit isitagentready.com ein kostenloses Tool veröffentlicht, das genau das misst. Du gibst deine URL ein, nach wenigen Sekunden bekommst du einen Score zwischen 0 und 100 sowie eine Einordnung in fünf Level – von “Nicht bereit” bis “Agent-Native”. Dazu eine klare Aufschlüsselung, was fehlt und was du tun kannst.

Das Tool prüft drei Dimensionen, die zusammen den Score ergeben. Keine davon ist besonders aufwendig umzusetzen – aber die wenigsten Websites haben sie im Einsatz. Genau darin liegt die Chance: Wer jetzt handelt, hat einen klaren Vorsprung.

Die drei Dimensionen von Agent Readiness

1. Discoverability – Wird deine Seite gefunden?

Bevor ein KI-Agent Inhalte verstehen kann, muss er sie überhaupt finden. Hier prüft das Tool drei klassische Signale: Eine korrekte robots.txt, eine gültige sitemap.xml und einen Link-Header in den HTTP-Antworten. Das sind keine neuen Konzepte – aber viele Websites haben hier Lücken oder veraltete Einträge, die Agenten ausbremsen.

Die Discoverability ist die Basis. Ohne sie helfen die schönsten Inhalte nichts. Viele dieser Punkte überschneiden sich mit klassischem technischem SEO – wer das schon gemacht hat, ist hier im Vorteil.

2. Content – Kann der Agent deine Inhalte effizient lesen?

Der Content-Check ist der spannendste Teil. Hier geht es um zwei Dinge: llms.txt und Markdown Content Negotiation.

Die llms.txt ist eine neue Konvention, ähnlich wie robots.txt, aber für KI-Systeme. In einer einzigen Datei stellst du deine wichtigsten Inhalte strukturiert bereit – als Übersicht für Agenten, damit sie nicht erst die gesamte Seite crawlen müssen. Das spart Ressourcen auf beiden Seiten und erhöht die Chance, dass deine Inhalte korrekt erfasst werden.

Markdown Content Negotiation bedeutet: Wenn ein Agent über den Accept-Header Markdown anfragt, liefert dein Server die Seite in Markdown aus – also in dem Format, das KI-Modelle ohnehin am besten verstehen. Kein HTML-Overhead, kein JavaScript, keine Navigation. Nur der reine Inhalt.

3. Bot Access Control – Wer darf was?

Der dritte Check dreht sich um Content Signals in der robots.txt. Hier legst du fest, welche Bots deine Inhalte für welchen Zweck nutzen dürfen. Willst du zum Trainieren von KI-Modellen beitragen? Oder nur in Such-Antworten auftauchen? Oder beides? Die Content Signals erlauben dir, das präzise zu steuern – ein wichtiger Baustein, der vor einem Jahr so noch nicht existierte.

Unser Praxistest: baubetreuer.berlin von 0 auf 100

Theorie ist schön, Praxis ist besser. Wir haben eines unserer Projekte durch das Tool geschickt: baubetreuer.berlin, eine Website für einen Berliner Baubetreuer. Beim ersten Test: ein schlechter Score. Die Seite war solide gebaut, mobil optimiert, schnell – aber für KI-Agenten praktisch unsichtbar. Keine llms.txt. Kein Link-Header. Keine Content Signals.

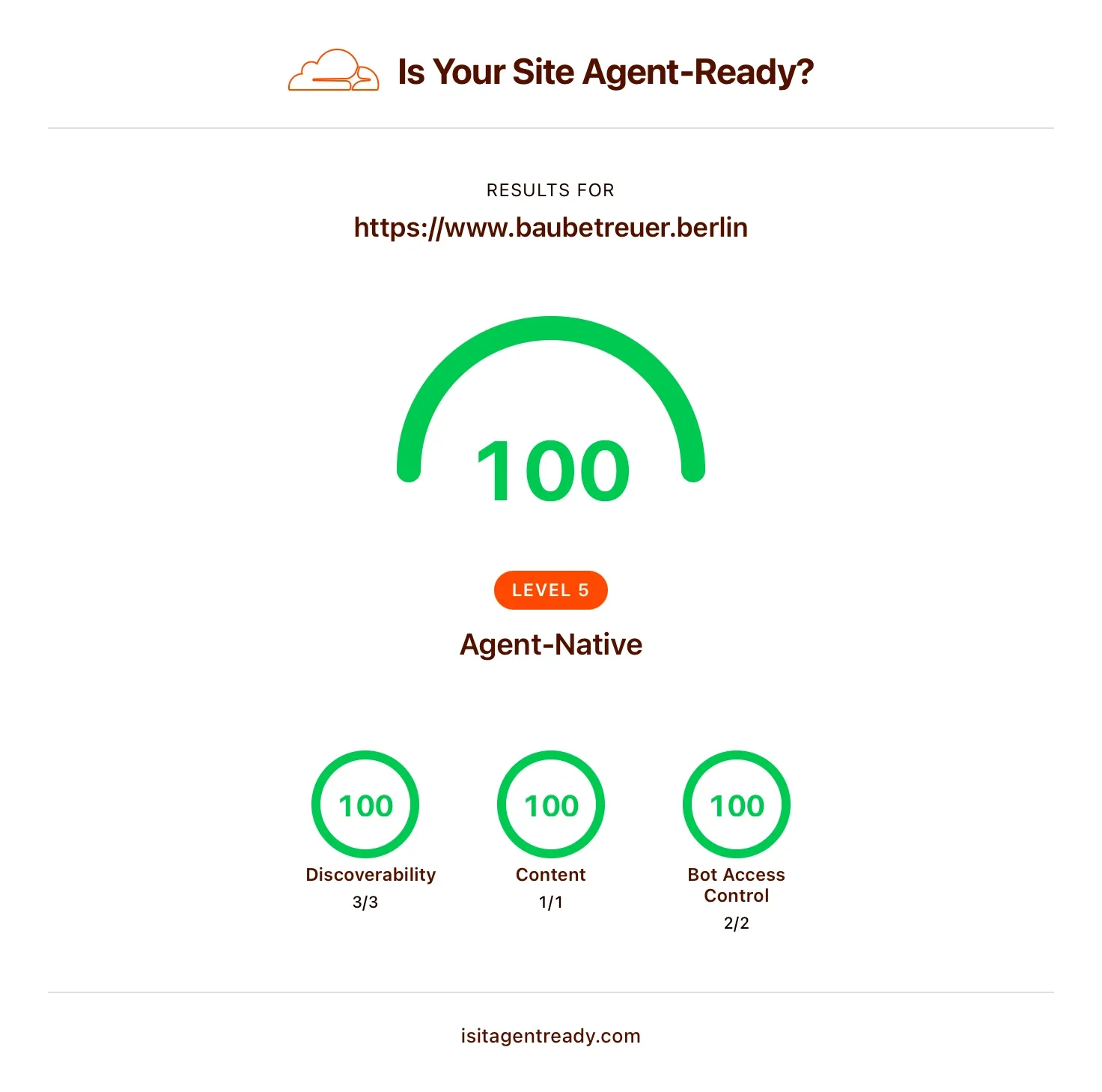

Wir haben die drei Dimensionen systematisch abgearbeitet: robots.txt ergänzt, sitemap.xml optimiert, Link-Header gesetzt, llms.txt generiert, Markdown Content Negotiation eingerichtet und Content Signals konfiguriert. Das Ergebnis nach wenigen Stunden Arbeit: 100/100 Punkte, Level 5 “Agent-Native”. Discoverability 3/3, Content 1/1, Bot Access Control 2/2.

Der Aufwand? Überschaubar. Der Effekt? Die Website ist jetzt vollständig vorbereitet auf eine Welt, in der KI-Agenten die erste Anlaufstelle für Informationen werden. Genau solche Projekte zeigen, wie konkret das Thema heute schon ist – und wie früh man mit wenig Aufwand einen echten Vorsprung aufbauen kann.

Was du jetzt tun kannst – besonders mit Astro

Wenn deine Website auf Astro läuft, hast du es besonders leicht. Astro liefert bereits statisches HTML aus, das Agenten sauber lesen können. llms.txt und Markdown-Versionen deiner Seiten lassen sich im Build-Prozess automatisch generieren – einmal eingerichtet, aktualisiert sich das bei jedem Deploy von selbst.

Praktische Schritte, egal welches System du nutzt:

- Teste deine Seite auf isitagentready.com – kostenlos, dauert unter einer Minute

- Prüfe robots.txt und sitemap.xml auf Aktualität und Vollständigkeit

- Erstelle eine llms.txt mit einer sauberen Übersicht deiner wichtigsten Inhalte

- Richte Markdown Content Negotiation ein, wenn dein Hosting das erlaubt

- Konfiguriere Content Signals, um festzulegen, wofür deine Inhalte genutzt werden dürfen

Wer mit Astro arbeitet, kann das alles in ein bestehendes Setup integrieren, ohne die Architektur zu ändern. Andere Systeme brauchen etwas mehr Arbeit – aber unmöglich ist es nirgends.

Agent Readiness ist das neue SEO

Als SEO vor 20 Jahren zum Thema wurde, haben die Agenturen gewonnen, die früh verstanden haben, wie Suchmaschinen ticken. Heute stehen wir an einem ähnlichen Punkt. KI-Agenten werden in den nächsten Jahren dramatisch mehr Verkehr erzeugen als klassische Suchmaschinen-Besucher. Wer seine Website jetzt vorbereitet, ist sichtbar, wenn der Wandel passiert.

Agent Readiness ersetzt SEO nicht – es ergänzt es. Beide Kanäle werden nebeneinander existieren, und beide zahlen auf das gleiche Ziel ein: gefunden und verstanden werden. Der Unterschied ist, dass AEO noch am Anfang steht. Standards wie llms.txt sind erst ein paar Monate alt. Genau das macht es zum perfekten Zeitpunkt, um vorne mit dabei zu sein.

Fazit

Die Art, wie Menschen Informationen finden, verändert sich gerade grundlegend. Wer das ignoriert, riskiert in den nächsten Jahren dasselbe, was unter-SEO-optimierte Websites vor 15 Jahren erlebt haben: Bedeutungsverlust bei gleichbleibender Qualität. Die gute Nachricht: Agent Readiness ist mit überschaubarem Aufwand erreichbar, und das Cloudflare-Tool liefert dir einen klaren Fahrplan.

Wenn du wissen willst, wie es um deine Website steht – oder Unterstützung bei der Optimierung brauchst – melde dich gerne bei uns. Wir haben das Thema für unsere eigenen Projekte und unsere Kunden bereits erfolgreich umgesetzt und beraten dich ehrlich, was für deine Seite wirklich sinnvoll ist. Schreib uns einfach an kontakt@creatives-berlin.de.